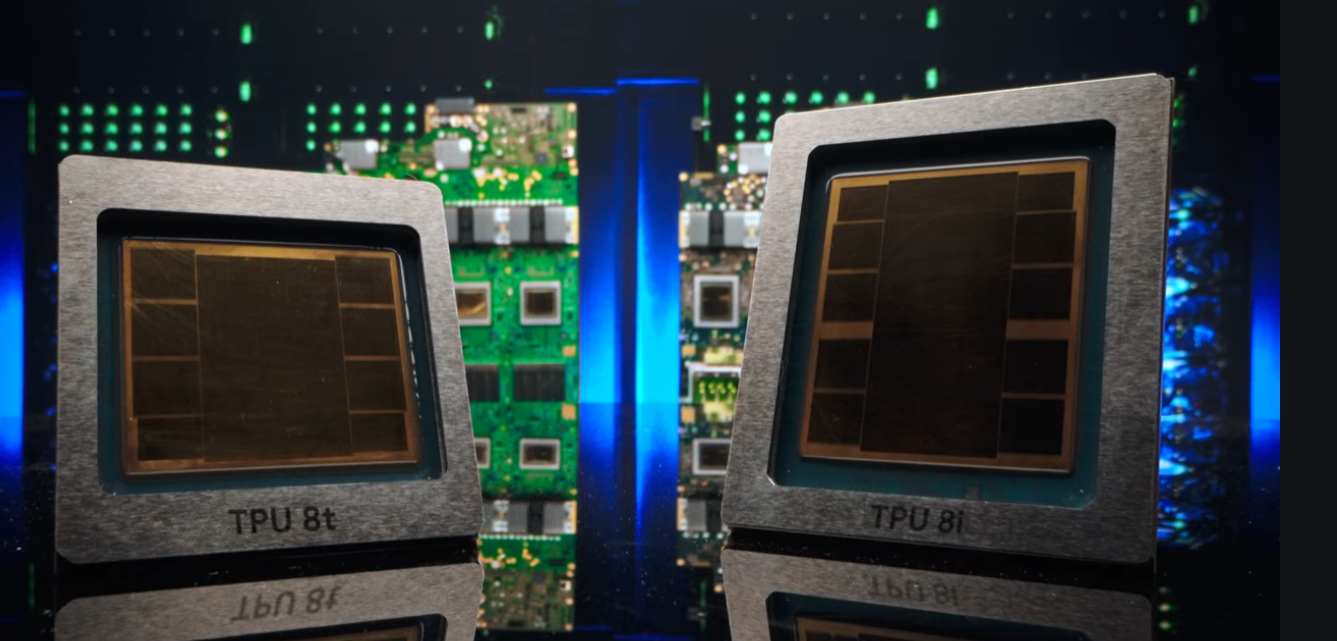

这是谷歌首次将训练芯片和推理芯片分开。

谷歌在博客文章中解释说,两款芯片都能运行各种工作负载,但专业化可以显著提高效率并获得收益。

-

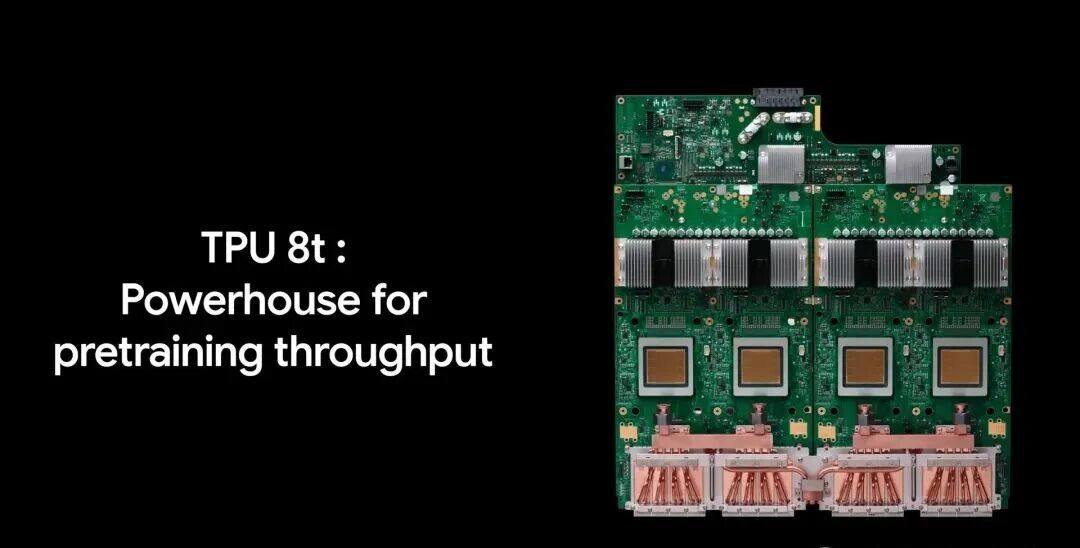

TPU 8t擅长处理大规模、计算密集型的训练工作负载,以提供更大的计算吞吐量和更强的可扩展带宽,旨在将前沿模型开发周期从数月缩短至数周。

-

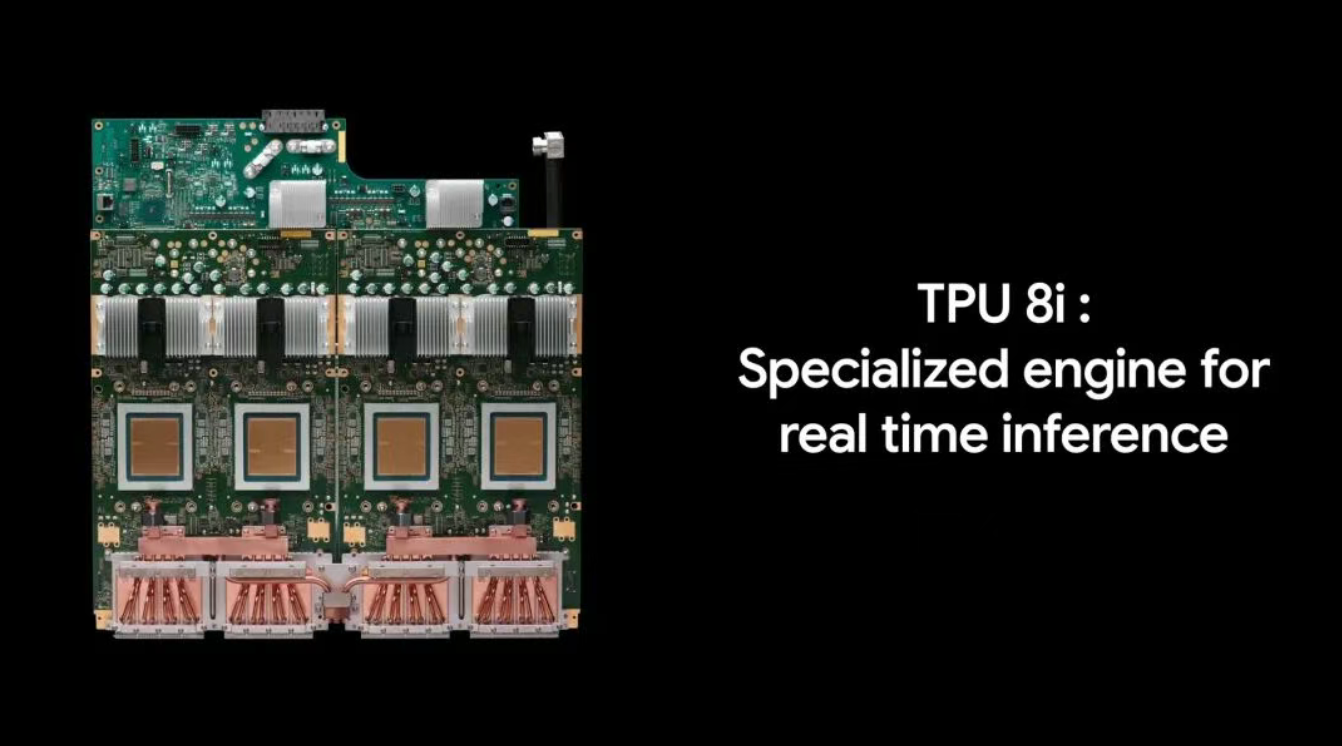

TPU 8i则拥有更高的内存带宽,专为对延迟最为敏感的推理工作负载而设计,旨在处理众多专业智能体复杂、协作、迭代的工作。

在性能层面,TPU 8t的每瓦性能较上一代提升124%,TPU 8i则提升117%。与去年11月发布的第七代Ironwood TPU相比,TPU 8t在同等价格下性能提升2.8倍,TPU 8i的性能则提升80%。

训练芯片TPU 8t最多可将9600块芯片组合成一套系统,谷歌表示,在部署如此大规模系统时,电力已成为数据中心的核心制约因素,更高的能效比因此至关重要。

2、TPU 8i主要面向推理场景,适用于运行AI模型及处理AI智能体任务。

信息来源:https://zhidx.com/p/551995.html、https://wallstreetcn.com/articles/3770631

推荐活动:2026年第三届 AI算力服务器液冷技术产业发展论坛

微信扫描下方的二维码阅读本文

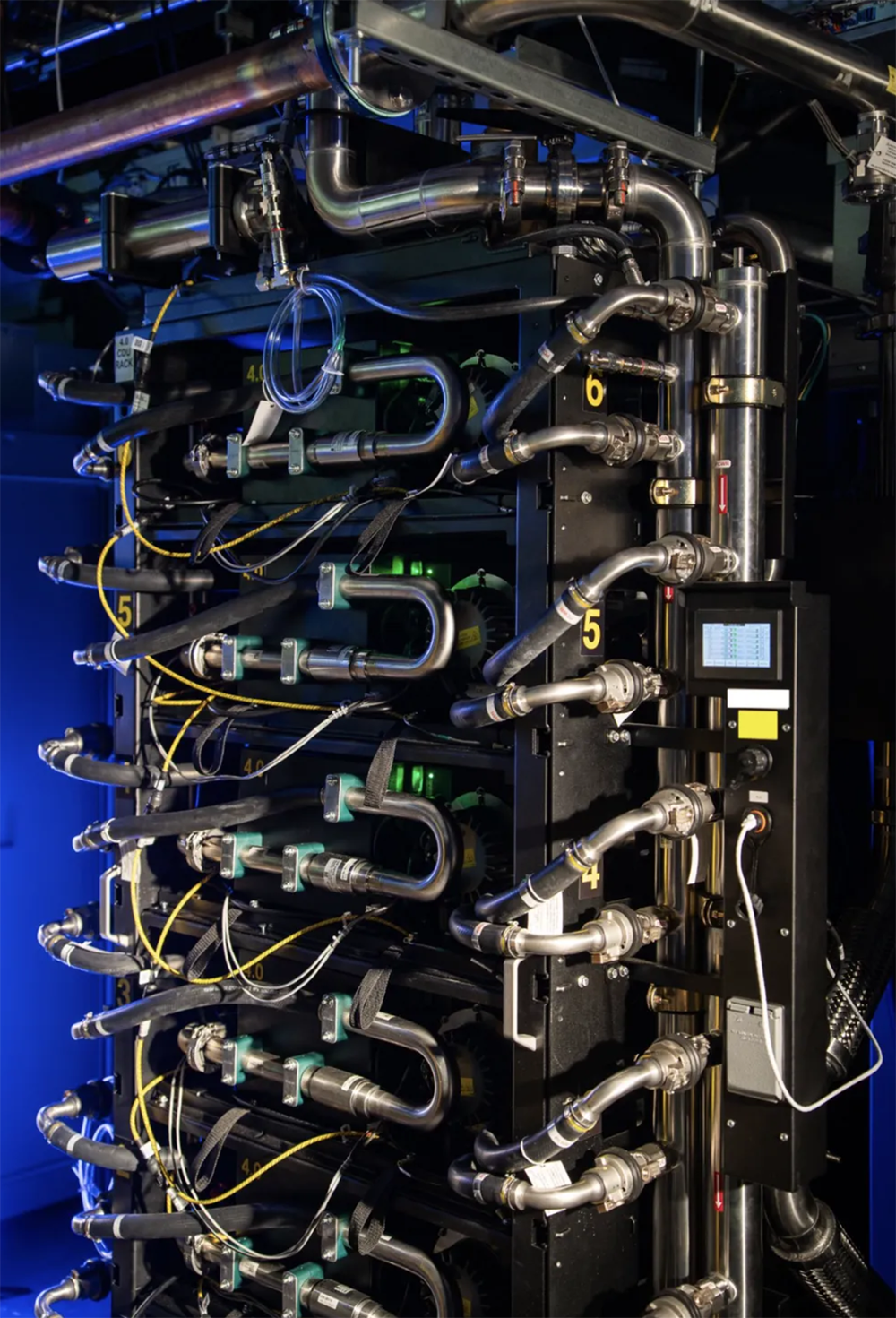

液冷技术通过冷却液直接/间接接触热源,核心结构包括:

长按识别二维码,申请入群 本群聚焦服务器液冷技术前沿,涵盖:

✅ 冷板/浸没/喷淋式方案设计

✅ 材料升级(耐腐蚀管路、密封件创新)

✅ CDU运维与能效优化

✅ 政策标准解读(PUE、OCP规范)

- 热交换核心 :冷板(CPU/GPU专用)、CDU(冷量分配单元);

- 循环网络 :Manifold分液器、EPDM/PTFE管路、快接头;

- 动力与控制 :变频循环泵(如飞龙股份电子泵)、智能温控系统。